随着人工智能技术的飞速发展,大型语言模型(LLM)在诸如自然语言处理、智能问答、文本生成等领域的应用越来越广泛。然而,LLM模型往往具有庞大的参数规模,导致推理过程计算量大、耗时长,成为了制约其实际应用的关键因素。为了解决这个问题,一系列大模型推理加速工具应运而生,其中vllm、fastllm和llama.cpp就是其中的佼佼者。本文将逐一介绍这三个工具的使用教程,并分享大模型推理的实践经验。

一、vllm使用教程

vllm是一个基于剪枝技术的大模型推理加速工具,通过去除模型中的冗余参数,可以在保证模型性能的同时显著减少推理时间。以下是使用vllm的基本步骤:

安装vllm库:从GitHub上克隆vllm的仓库,并按照官方文档进行安装。

加载预训练模型:使用vllm提供的API加载你想要加速的LLM模型。

模型剪枝:调用vllm的剪枝函数对模型进行剪枝,设置合适的剪枝率以达到最佳性能和速度的平衡。

推理:使用剪枝后的模型进行推理,你将发现推理速度得到了显著提升。

二、fastllm使用教程

fastllm是一个基于量化技术的大模型推理加速工具,通过降低模型参数的精度,可以在保证模型性能的同时减少推理所需的计算资源和内存占用。以下是使用fastllm的基本步骤:

安装fastllm库:从GitHub上克隆fastllm的仓库,并按照官方文档进行安装。

加载预训练模型:使用fastllm提供的API加载你想要加速的LLM模型。

模型量化:调用fastllm的量化函数对模型进行量化,选择合适的量化位数以达到最佳性能和速度的平衡。

推理:使用量化后的模型进行推理,你将发现推理速度和内存占用都得到了优化。

三、llama.cpp使用教程

llama.cpp是一个基于C++实现的大模型推理工具,通过优化底层计算和内存管理,可以在不牺牲模型性能的前提下提高推理速度。以下是使用llama.cpp的基本步骤:

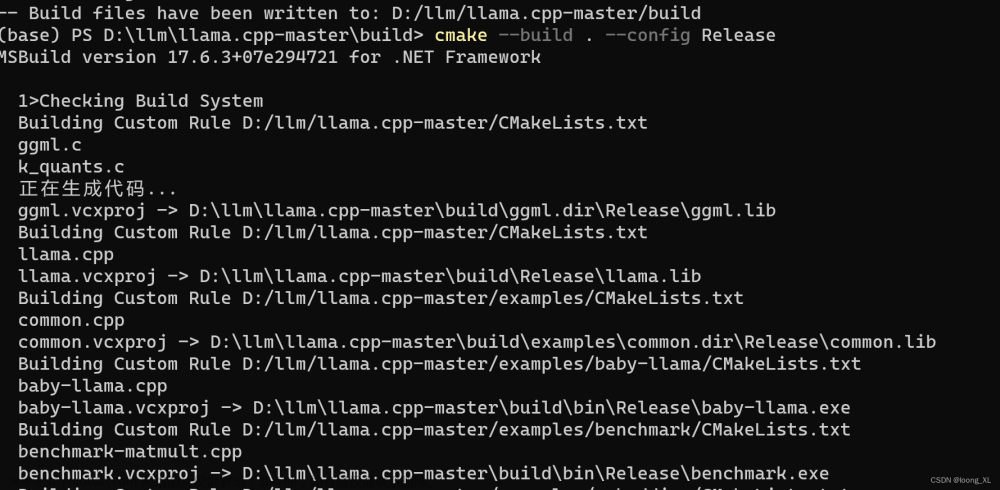

安装llama.cpp库:从GitHub上克隆llama.cpp的仓库,并按照官方文档进行安装。

加载预训练模型:使用llama.cpp提供的API加载你想要加速的LLM模型。

配置推理参数:根据实际需要配置推理过程中的参数,如批处理大小、并行度等。

推理:使用llama.cpp进行推理,你将发现推理速度得到了显著提升,并且可以利用C++的灵活性进行更高级别的定制和优化。

四、大模型推理总结

在使用上述工具进行大模型推理加速时,需要注意以下几点:

选择合适的加速策略:根据模型特点和应用场景选择合适的加速策略,如剪枝、量化或底层优化。

平衡性能和速度:在加速过程中要权衡模型性能和推理速度的关系,避免过度加速导致模型性能下降。

注意可移植性和兼容性:选择具有良好可移植性和兼容性的加速工具,以便在不同平台和环境下使用。

关注最新进展:随着技术的不断发展,新的加速方法和工具不断涌现。保持关注最新进展,及时了解和尝试新的加速方法,以不断提升大模型推理的性能和效率。文章来源:https://www.toymoban.com/news/detail-850089.html

通过以上介绍和实践经验分享,相信读者对如何使用vllm、fastllm和llama.cpp进行大模型推理加速有了更深入的了解。希望这些知识和经验能够帮助读者在实际应用中更好地应对大模型推理的挑战,推动人工智能技术的发展和应用。文章来源地址https://www.toymoban.com/news/detail-850089.html

到了这里,关于LLM大模型推理加速实战:vllm、fastllm与llama.cpp使用指南的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!