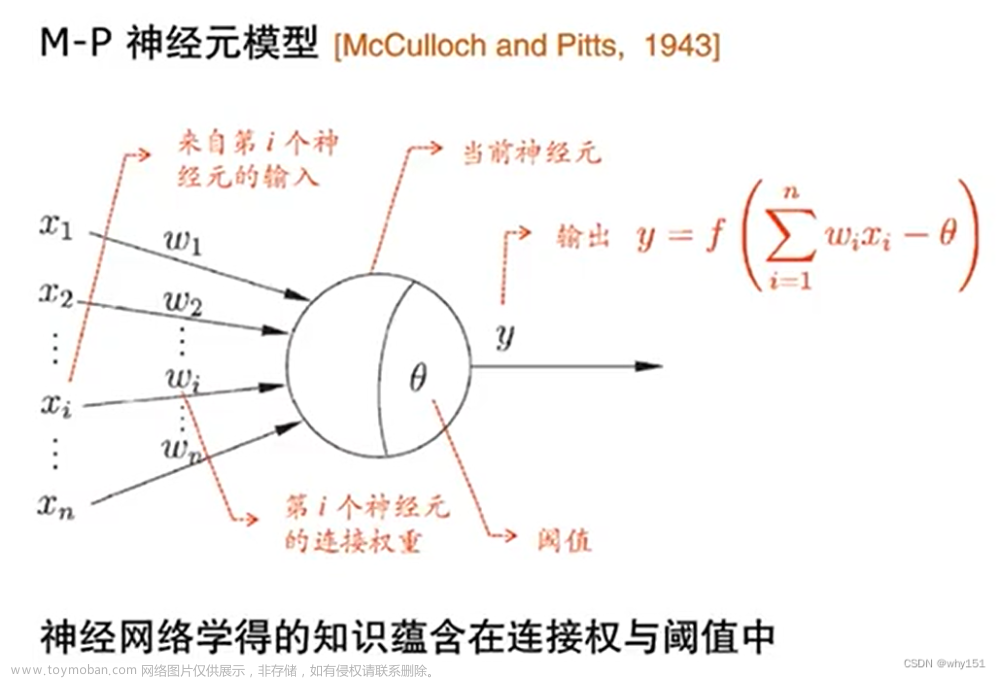

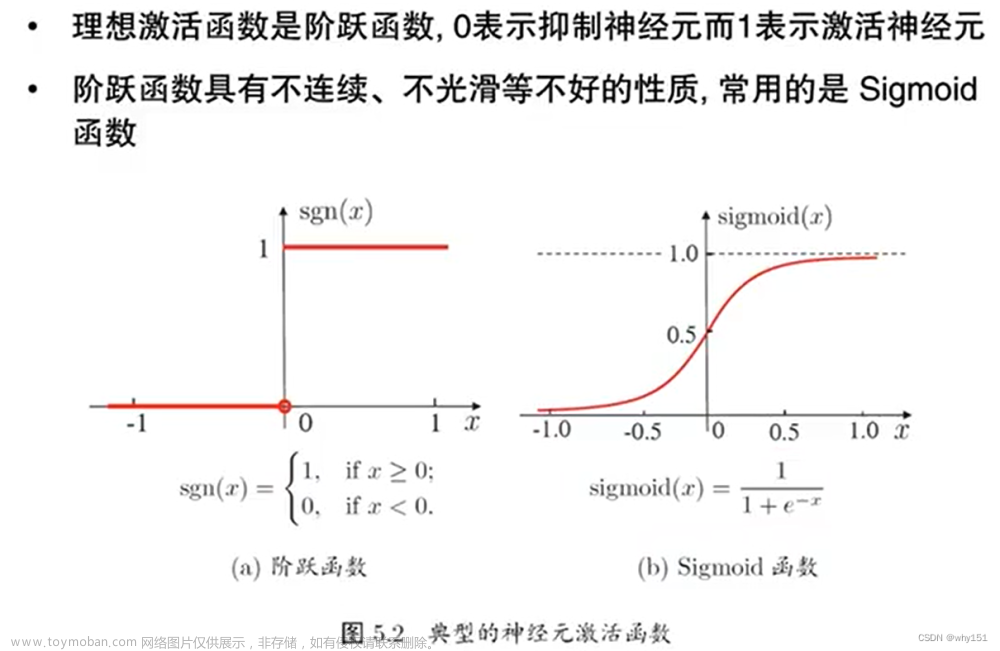

神经元模型

上述定义的简单单元即为神经元模型。

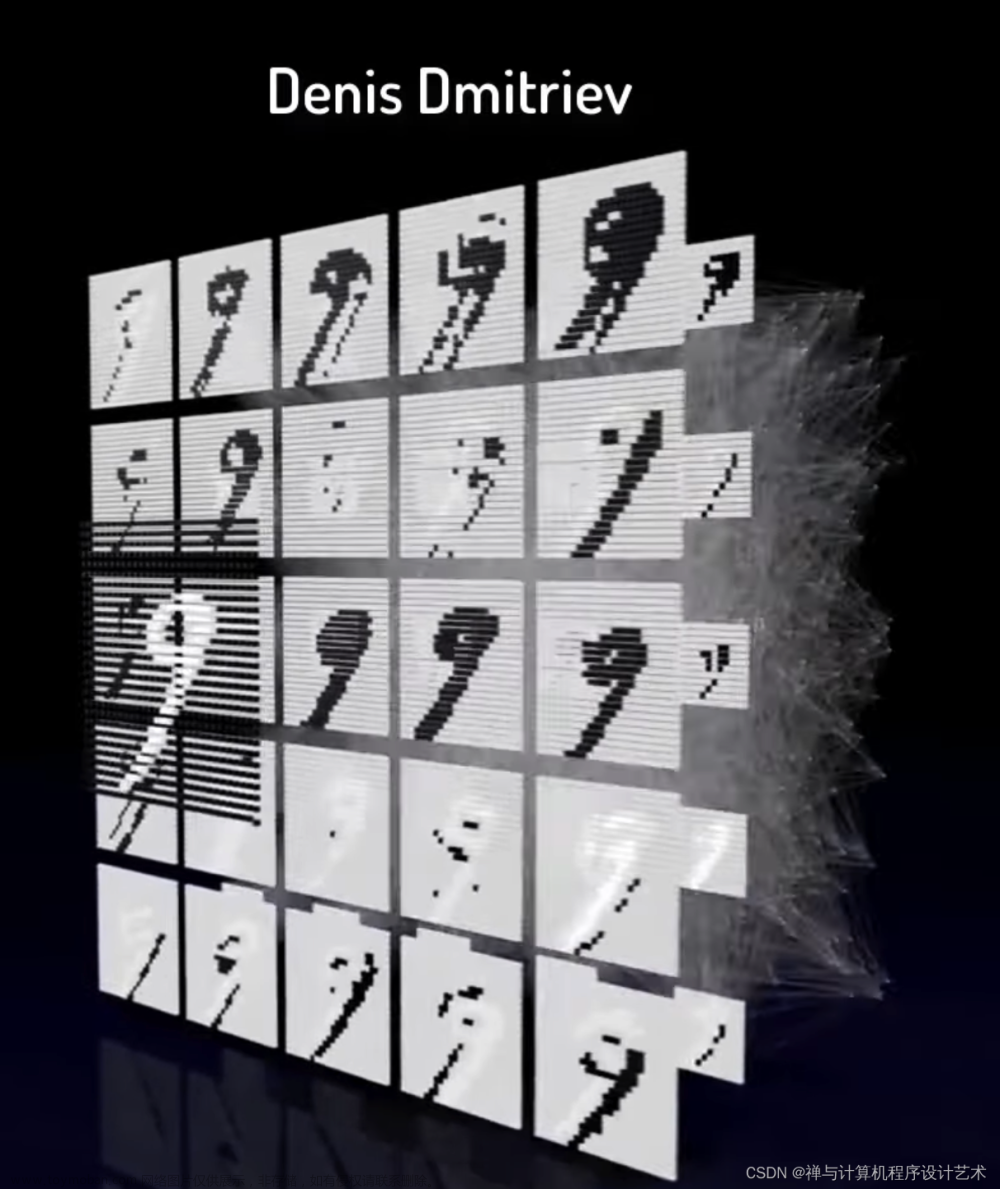

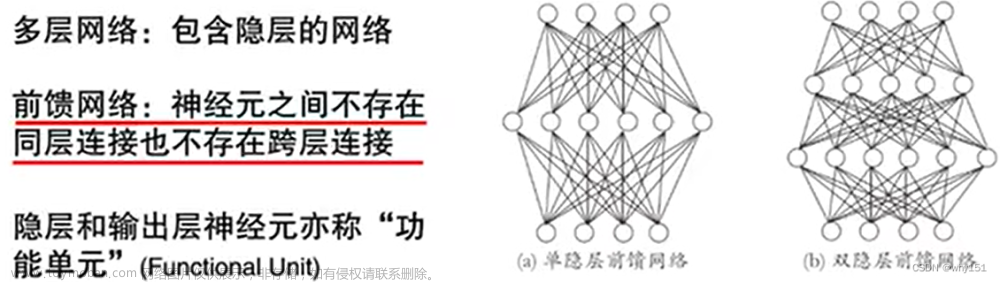

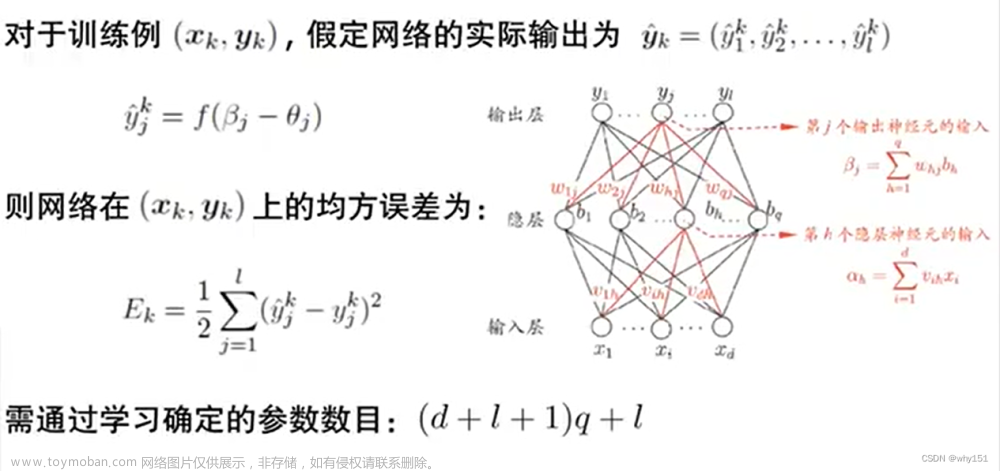

多层网络

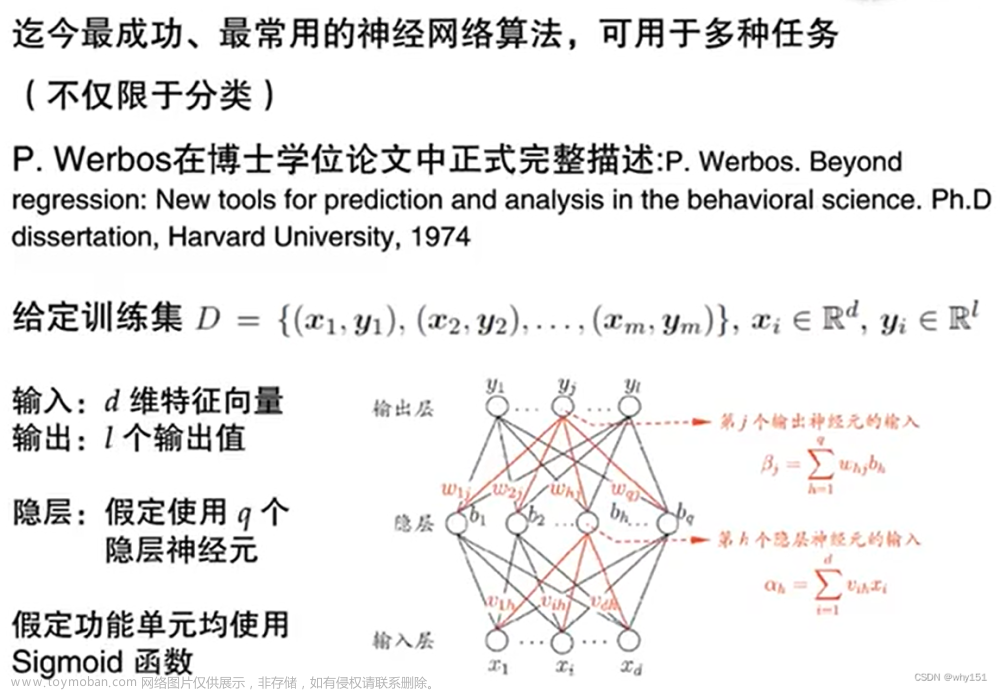

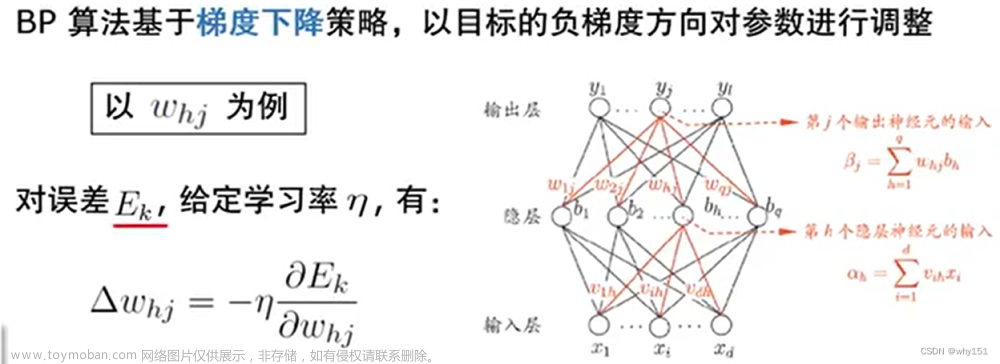

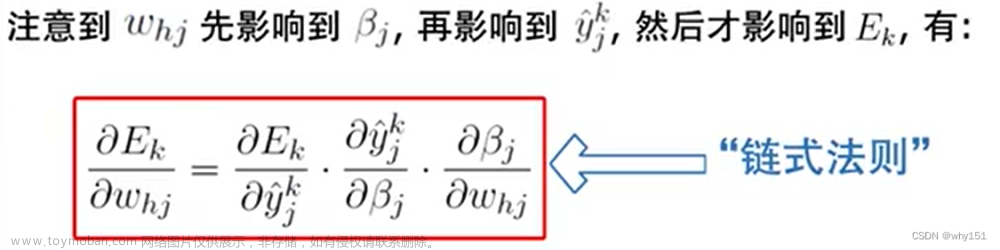

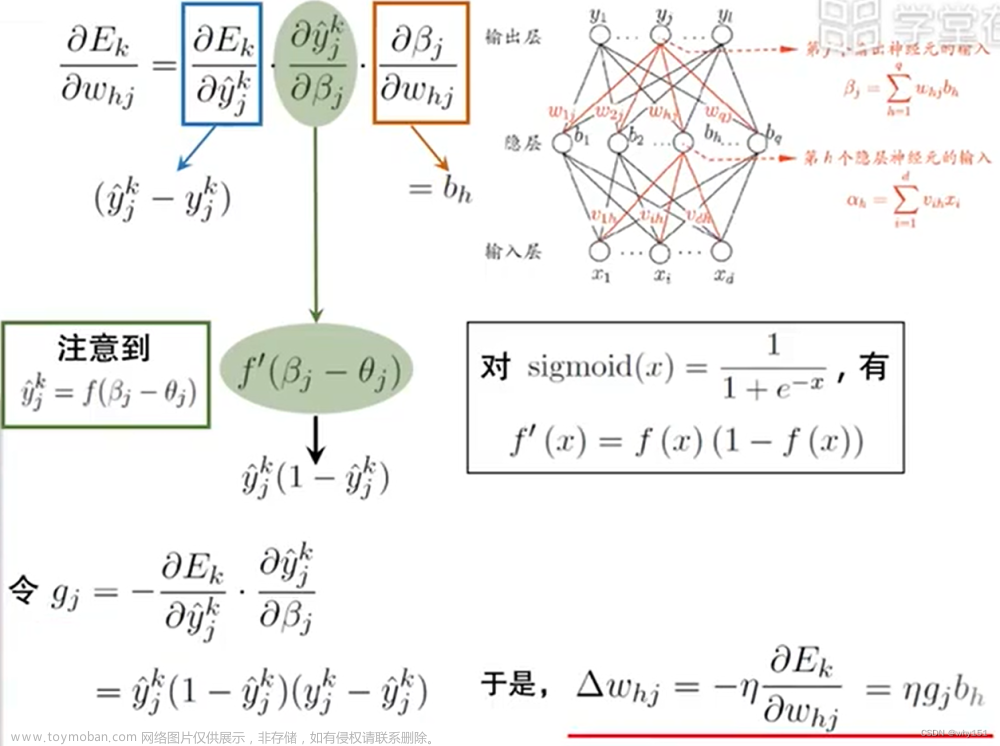

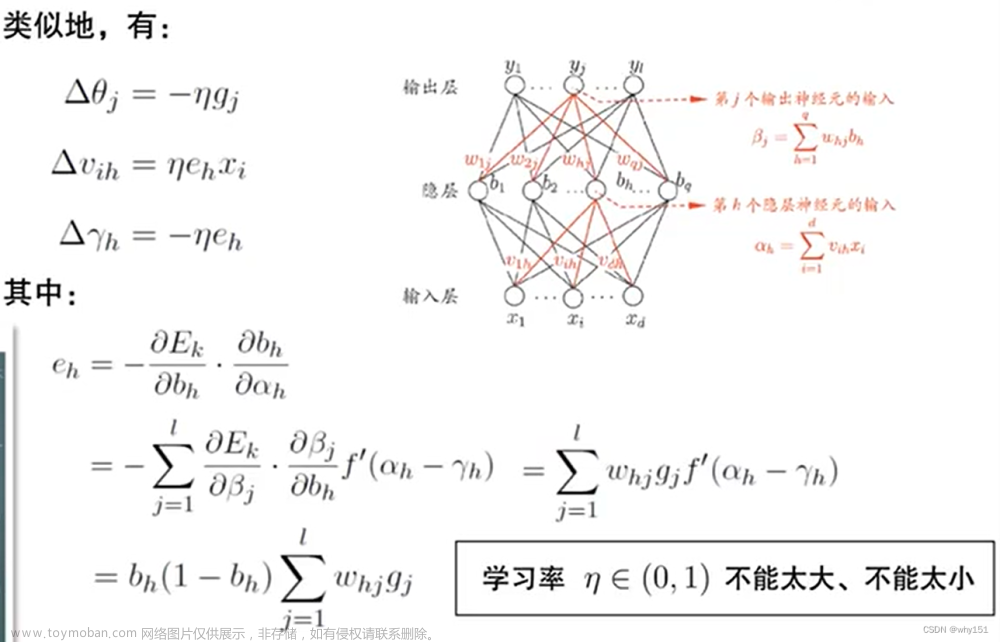

误差逆传播算法

- 标准BP算法:参数更新非常频繁,可能出现抵消现象。

- 积累BP算法:下降到一定程度上,进行下一步会非常缓慢。

过拟合文章来源:https://www.toymoban.com/news/detail-647894.html

- 早停:划分训练集和验证集,若训练集误差降低而验证集升高则停止训练。

- 正则化:在误差目标函数中加入一个用于描述网络复杂度的部分, E = λ 1 m ∑ k = 1 m E k + ( 1 − λ ) ∑ i w i 2 E=\lambda\frac{1}{m}\sum_{k=1}^mE_k+(1-\lambda)\sum_iw_i^2 E=λm1∑k=1mEk+(1−λ)∑iwi2

全局最小与局部极小

- 局部极小解:是参数空间的某个点,其邻域点的误差函数值均不小于该点的误差函数值,可能存在多个。

- 全局极小解:是指参数空间中所有点的误差函数值均不小于该点的误差函数值,只存在一个。

如何跳出局部极小值点?文章来源地址https://www.toymoban.com/news/detail-647894.html

- 以多组不同参数值初始化多个神经网络,取误差最小的解。

- 使用模拟退火,在每一步都有一定概率接受比当前解更差的算法。

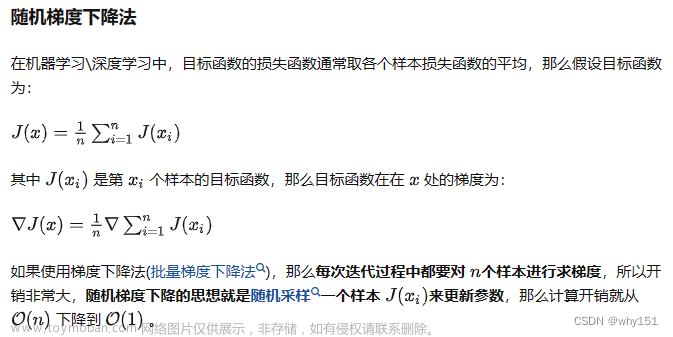

- 使用随机梯度下,即便陷入局部极小点,它计算出来的梯度仍然可能不为0。

到了这里,关于第5章:神经网络的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!